Publicaron una guía para detectar cuando un rostro fue generado por la inteligencia artificial

El documento busca fortalecer defensas contra fraudes biométricos que aprovechan imágenes manipuladas para engañar sistemas de reconocimiento facial.

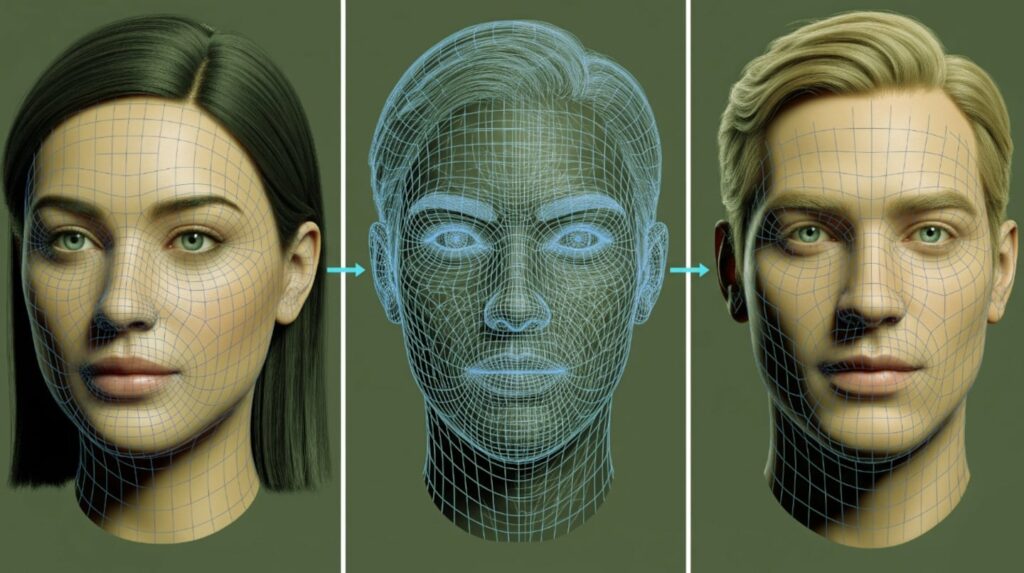

El Instituto Nacional de Estándares y Tecnología de Estados Unidos (NIST) publicó esta semana una guía que busca ayudar a gobiernos, bancos y empresas a detectar intentos de fraude medianteface morphing, una técnica que combina los rasgos de dos o más personas en una sola imagen para engañar sistemas de reconocimiento facial.

Si bien esta tecnología surgió en los años 90 como un recurso creativo para cine y publicidad, investigadores demostraron que con la ayuda de la inteligencia artificial (IA) puede tener graves consecuencias en la actualidad: fraudes en pasaportes, accesos corporativos y hasta en sistemas financieros y militares.

Qué es y cómo funciona el face morphing

El periodista especialista en ciberseguridad Juan Brodersencontó a TN Tecno que el proceso de face morphing es capaz de generar rostros híbridos que los algoritmos de biometría reconocen como válidos.

“Esto lo convierte en un riesgo de primer nivel para sistemas que hoy sostienen desde la apertura de cuentas en bancos, apps financieras y exchanges de criptomonedas hasta los controles militares y fronterizos en aeropuertos», explicó.

El documento presentado por NIST propone un abordaje automatizado: buscar detalles e inconsistencias en las imágenes que suelen pasar desapercibidas al ojo humano, como diferencias en texturas de piel, coloraciones poco naturales, o irregularidades en zonas sensibles como iris, labios o cejas.

Además, la guía diferencia estrategias según el escenario: no es lo mismo un trámite en migraciones en tiempo real que un control de acceso empresarial, por lo que sugiere adaptar las defensas al contexto.

En declaraciones al newsletter Dark News, el doctor en Informática por la Universidad de Eindhoven y docente en la Universidad Nacional de Córdoba, Javier Blanco, explicó que este es un terreno en el que la inteligencia artificial juega en ambos bandos:“Para poder diferenciar una cuestión hecha con una determinada tecnología, solo la misma tecnología la puede distinguir. Así como hubo una carrera por la criptología y el criptoanálisis, esto es parecido”.

El especialista agregó que, en el fondo, es un problema que va más allá de lo técnico: “Evoluciona tan rápido esta tecnología que no parece que se vaya a resolver de una vez y para siempre. Es un problema político de primer orden: tiene que estar en la agenda pública, aunque no sea para resolverlo, sí para conocerlo y entender los alcances y las preocupaciones sociales que esto puede generar”, aseguró.

Recomendaciones del NIST

De acuerdo al informe, la mejor defensa es prevenir que las imágenes manipuladas ingresen a los sistemas. Para lograrlo, NIST propone:

1. Sacar la foto en persona y con ayuda (Inscripción en vivo con asistencia):

- Esta es la forma más segura. Consiste en que la foto se tome en el momento, y haya un empleado de confianza presente que la supervise.

2. Sacar la foto de forma confiable, pero sin asistencia directa (Captura confiable sin asistencia):

- Cuando no es posible que un empleado supervise la toma de la foto en persona, existen otras opciones, aunque son un poco menos seguras. Por ejemplo, se pueden usar cabinas de fotos especiales. Estos equipos deben tener seguridad para evitar trampas. También se pueden usar aplicaciones de celular o tablet seguras y especializadas que tienen defensas contra manipulaciones.

Además, la organización explicó que existen dos maneras de detectar las fotos falsas de rostros generados con IA:

a. Programas especializados

Estos software comparan millones de fotos reales con las imágenes que ingresan a los sistemas.

b. Técnicas de investigación cuando una foto es marcada como sospechosa

Si un programa detecta algo o si alguien sospecha, se revisa la foto con más detalle:

- Inspección visual: un experto mira la foto

► Se buscan detalles o irregularidades en los ojos, nariz, labios, cejas, piel, o características faciales que no son anatómicamente posibles.

► Se compara la foto con fotos anteriores para ver si faltan o cambian características como cicatrices, lunares o la forma de las orejas.

- Metadatos de la foto

► Se revisa la información oculta del archivo de la foto (como la fecha de toma, la cámara o el programa usado) para ver si hay inconsistencias.

- Otras características biométricas

► Si el documento tiene también huellas dactilares o escaneos del iris (tomados en persona), se usan para verificar la identidad, ya que son muy difíciles de manipular.

- Reconocimiento facial

► Comparación 1 a 1: se compara la foto sospechosa con una foto en vivo. Si el sistema da un puntaje de similitud raro (ni muy parecido ni muy diferente), podría ser una imagen manipulada.

El face morphing ya no es solo un recurso creativo: se convirtió en un desafío real para la seguridad digital y física. Con sistemas biométricos cada vez más presentes en la vida cotidiana, conocer los riesgos y aplicar medidas preventivas es clave para evitar que las identidades sean vulneradas.

Al respecto, la guía del NIST recuerda existen herramientas y procedimientos que permiten minimizar estos riesgos. La combinación de detección automatizada, revisión humana y medidas de seguridad en la captura de imágenes se perfila como la estrategia más efectiva para proteger los sistemas críticos frente a fraudes.

Fuente: TN