Desconcierto entre los usuarios de ChatGPT luego de que el chatbot respondiera con letras árabes

Usuarios del modelo de OpenAI revelaron cambios aleatorios en el idioma de salida. No es la primera vez que lo hace: antes tuvo problemas con el “spanglish”.

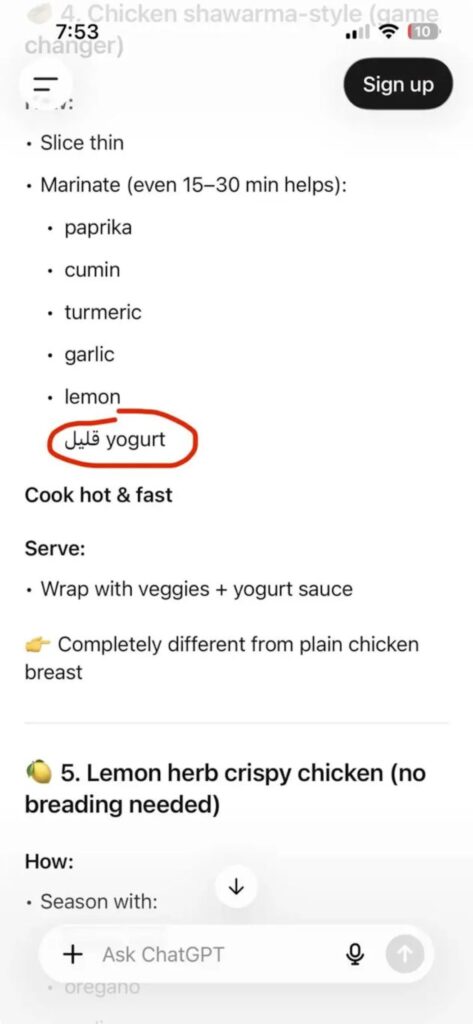

Un grupo de usuarios de ChatGPTque conversan con el chatbot en inglés manifestaron su desconcierto luego de que el modelo de OpenAI respondiera a las consultas con palabras en árabe.

Los reportes se viralizaron en las redes. “Lo hizo dos veces en mi teléfono y una vez en mi computadora. Ni siquiera estoy en un país de habla ese idioma”, reveló uno de los usuarios.

En un tuit, otro de los que detectó este comportamiento extraño de ChatGPTdijo que el sistema de inteligencia artificial decidió por su cuenta insertar algunos términos en árabe mientras lo ayudaba a redactar un prompt para crear un logotipo.

Caracteres de ese idioma también aparecieron en recetas que mostró ChatGPT, tal como vemos en la captura de pantalla que un usuario perplejo compartió en Reddit.

ChatGPT respondió en árabe: el detrás de escena del error

El modelo de lenguaje masivo de OpenAI, GPT, es capaz de funcionar en diversos idiomas. Cabe señalar, en tanto, que la rareza del comportamiento reportado radica en que haya respondido en lenguas diferentes a las que emplearon los usuarios.

De hecho, New York Post menciona que ChatGPT también usó caracteres de idiomas diferentes al de las entradas, entre ellos del hebreo, hindi, chino y ruso.

Cuando los usuarios preguntaron al chatbot por qué incurrió en esos deslices, simplemente respondió que las palabras en otros idiomas “se colaron por error”.

Las inconsistencias en ChatGPT y en otros sistemas de IA generativa no son precisamente novedosos. Tal como contamos anteriormente en TN Tecno, estos chatbots en ocasiones sufren de lo que en la jerga se llama “alucinaciones de la IA”. En la práctica, son respuestas que inventa: resultados inexactos, incorrectos y/o que no tienen sentido que son la consecuencia de problemas en el entrenamiento.

En el caso de las respuestas del chatbot en idiomas diferentes al de entrada, la explicación es diferente a las mencionadas alucinaciones. La clave es una suerte de tara en la programación.

En este punto, hay que tener en cuenta que los modelos de IA se entrenan utilizando tokens, que corresponden a los datos que procesa, desde textos, hasta imágenes, videos y audios.

Vale la aclaración: un token es la unidad básica de texto que usa el modelo para procesar y generar lenguaje.

“Los modelos de lenguaje complejos como ChatGPT pueden representar palabras cortas con un token, mientras que dividen palabras largas en varias, asignando a cada una de estas abreviaturas digitales un número diferente. Cuanto más eficiente sea la tokenización, menor será la potencia de cálculo necesaria para el entrenamiento y la inferencia”, explica la fuente.

Siendo que estos sistemas se entrenan con datos en múltiples idiomas, tal como señalamos más arriba, podrían incluir palabras en otras lenguas, más cortas y más fáciles de procesar.

Por lo demás, esta no es la primera vez que ChatGPT incurre en problemas idiomáticos. En el 2024, muchos usuarios se sorprendieron al encontrar un “colapso” que llevó al chatbot a entregar respuestas incoherentes y a hablar en “spanglish”, una mezcla entre el inglés y el español.

Fuente: TN